AI χαρακτήρες συνομιλίες, όπωςPolybuzz.ai, Αφήστε τα παιδιά και σχεδόν οποιονδήποτε άλλον να συνομιλεί με εικονικούς χαρακτήρες που μιμούνται διασημότητες ή φανταστικές φιγούρες, που τροφοδοτούνται από προχωρημένα μοντέλα AI. Αυτές οι εφαρμογές είναι δημοφιλείς μεταξύ των παιδιών για τη διαδραστική και διασκεδαστική φύση τους, προσφέροντας μια αίσθηση συντροφιάς και διαφυγής.

Ωστόσο, αυτές οι εφαρμογές αποτελούν επίσης αρκετούς κινδύνους, συμπεριλαμβανομένων των ανησυχιών για την προστασία της ιδιωτικής ζωής, της παραπληροφόρησης, της ακούσιας συναισθηματικής προσκόλλησης σε εικονικούς χαρακτήρες, ακατάλληλου περιεχομένου και πιθανής εκμετάλλευσης από τους θηρευτές. Ενώ οι γονικοί έλεγχοι μπορούν να προσπαθήσουν να εμποδίσουν την πρόσβαση, τα παιδιά συχνά παρακάμπτουν τα χρησιμοποιώντας έξυπνες τεχνικές, υπογραμμίζοντας την ανάγκη για εμπιστοσύνη και επικοινωνία μόνο για τεχνικές διασφαλίσεις μόνο.

Πίνακας περιεχομένων

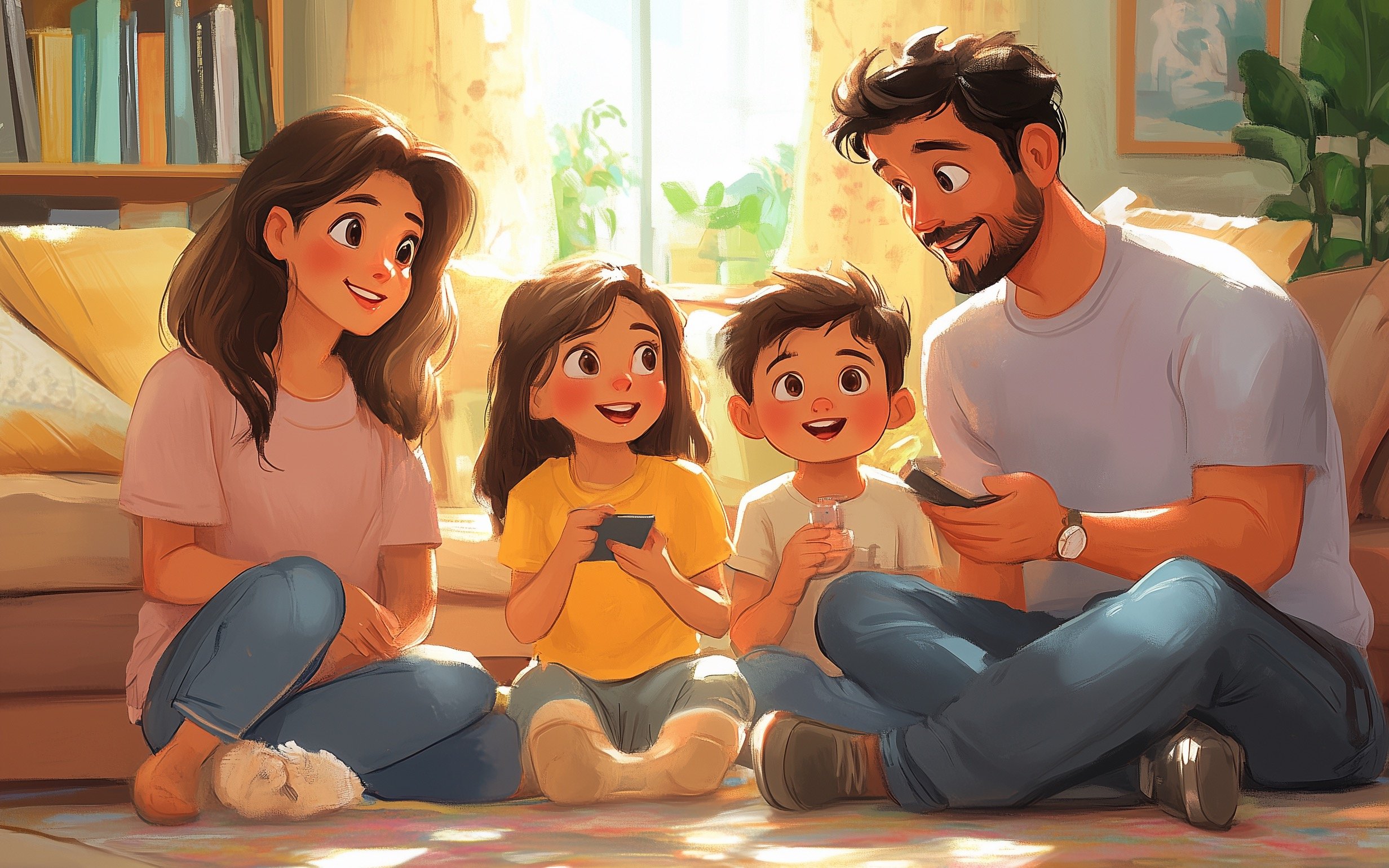

Κατά την εκτίμησή μας, το καλύτερο πράγμα που μπορούν να κάνουν οι γονείς είναι να εκπαιδεύσουν τα παιδιά για το AI, να θέσουν σαφή όρια χρήσης και να ενθαρρύνουν την κριτική σκέψη να αμφισβητήσουν τις απαντήσεις του AI. Η εστίαση σε πραγματικές κοινωνικές αλληλεπιδράσεις βοηθά επίσης τα παιδιά να εξισορροπήσουν την ψηφιακή δέσμευση, μειώνοντας την εξάρτησή τους από την AI για συναισθηματική υποστήριξη. Εάν μπορείτε να έχετε έναν ανοιχτό διάλογο με το παιδί σας και αισθάνονται άνετα να μοιράζονται τις εμπειρίες τους μαζί σας, αυτό μπορεί να σας βοηθήσει να μετριάσετε τα θέματα ασφαλείας με αυτά τα εργαλεία.

Οι εφαρμογές συνομιλίας χαρακτήρων AI αξιοποιούν την επεξεργασία της φυσικής γλώσσας για να προσομοιώσουν τις αλληλεπιδράσεις που μοιάζουν με ανθρώπινα, επιτρέποντας στους χρήστες να συμμετέχουν με προσαρμόσιμους χαρακτήρες. Για παράδειγμα, ο χαρακτήρας.

Αυτές οι εφαρμογές είναι δημοφιλείς λόγω της διασκέδασης, ρεαλιστικής τους φύσης. Αφήνουν τα παιδιά να αλληλεπιδρούν ή να δημιουργούν χαρακτήρες που τους ενδιαφέρουν ή τους ενθουσιάζουν. Ωστόσο, η ευκολία πρόσβασης και προσφυγής τους αυξάνει σημαντικές ανησυχίες για την ασφάλεια, ειδικά για τους νεότερους χρήστες.

Λεπτομερείς κινδύνους που σχετίζονται με εφαρμογές συνομιλίας AI

Οι κίνδυνοι είναι σημαντικοί, επηρεάζοντας την προστασία της ιδιωτικής ζωής, τη συναισθηματική ευεξία και την ασφάλεια:

- Ανησυχίες για την ιδιωτική ζωή: Αυτές οι εφαρμογές συλλέγουν δεδομένα χρήστη, συμπεριλαμβανομένων προσωπικών στοιχείων και ιστοριών συνομιλίας, τα οποία θα μπορούσαν να χρησιμοποιηθούν ή να μοιραστούν χωρίς συγκατάθεση. Ένα άρθρο απόΚινητόΥπογράμμισε ότι οι υπηρεσίες πολιτικής απορρήτου του χαρακτήρα.AI δεν προορίζονται για ανηλίκους, ωστόσο η επιβολή είναι αδύναμη, ενδεχομένως εκθέτοντας τα παιδιά σε διαρροές δεδομένων και εκμεταλλεύσεις.

- Κακή πληροφορία: Το AI chatbots μπορεί να παρέχει ανακριβείς ή παραπλανητικές πληροφορίες, τις οποίες τα παιδιά ενδέχεται να αποδεχθούν χωρίς επαλήθευση. Ερευνώ απόQustodioΣημείωσε ότι οι εξατομικευμένες αλληλεπιδράσεις του χαρακτήρα.

- Συναισθηματική προσκόλληση: Τα παιδιά μπορεί να σχηματίσουν ισχυρούς δεσμούς με εικονικούς χαρακτήρες, αντικαθιστώντας πρακτικά τις ανθρώπινες σχέσεις. Μια πρόσφατη μελέτη της Ekaterina Pashevich, που αναφέρεται στοSafes.so, προειδοποίησε ότι οι τακτικές αλληλεπιδράσεις θα μπορούσαν να επηρεάσουν την κοινωνική ανάπτυξη, με το ΑΙ να στερείται του συναισθηματικού βάθους και της ενσυναίσθησης της ανθρώπινης επαφής.

- Ακατάλληλο περιεχόμενο: Μερικοί χαρακτήρες, όπως ένας "τοξικός φίλος" ή "εξαπατώντας φίλη" στο χαρακτήρα. Αυτός ο κίνδυνος αυξάνεται περαιτέρω από αδύναμα φίλτρα NSFW, τα οποία τα παιδιά μπορούν να παρακάμψουν, οδηγώντας σε έκθεση σε ακατάλληλο ή πορνογραφικό περιεχόμενο.

- Δυναμικό εκμετάλλευσης: Οι θηρευτές ή οι απατεώνες χρησιμοποιούν επίσης αυτές τις πλατφόρμες για να στοχεύσουν τα παιδιά, εκμεταλλευόμενοι την ανωριμότητα και την εμπιστοσύνη τους. Το 2024, ο 14χρονος αυτοκτόνησε μετά από αλληλεπίδραση με χαρακτήρα.Νέοςάρθρο.

Σύμφωνα με τον Επίτροπο Esafety του 2025ιστολόγιοΣτο AI chatbots, οι περισσότεροι από τους διαθέσιμους 10+ συντρόφους AI είχαν ελάχιστους έως μηδενικούς περιορισμούς και πολλοί διατέθηκαν στο εμπόριο σε νέους χρήστες χωρίς κατάλληλους ελέγχους ασφαλείας.

Περιορισμοί των γονικών ελέγχων

Δυστυχώς, ενώ οι γονικοί έλεγχοι μπορούν να περιορίσουν την πρόσβαση των εφαρμογών ή την ώρα της οθόνης, απέχουν πολύ από το να είναι ανόητοι. Τα παιδιά, που όλοι γνωρίζουμε ότι είναι τεχνολογικά καταλαβαίνω, μπορούν εύκολα να παρακάμψουν τα χειριστήρια χρησιμοποιώντας συσκευές φίλων ή μέσω VPNs. Τα παιδιά βρίσκουν δημιουργικούς τρόπους καταστροφής περιορισμών, πράγμα που σημαίνει ότι οι περισσότερες τεχνικές διασφαλίσεις δεν θα μπορούν να αντιμετωπίσουν αυτά τα θέματα. Αυτοί οι περιορισμοί υπογραμμίζουν την ανάγκη για εμπιστοσύνη και ανοιχτή επικοινωνία για να συμπληρώσουν, όχι να αντικαταστήσουν, αυτά τα εργαλεία.

Οικοδόμηση εμπιστοσύνης και ανοιχτής επικοινωνίας: Στρατηγικές για τους γονείς

Για να μετριάσουν τους κινδύνους, οι γονείς πρέπει να δώσουν προτεραιότητα στην οικοδόμηση εμπιστοσύνης και στη διατήρηση του συνεχιζόμενου διαλόγου. Ορισμένες βασικές στρατηγικές περιλαμβάνουν:

- Εκπαιδεύστε τα παιδιά για το AI: Οι γονείς πρέπει να εξηγήσουν τις εργασίες και τους κινδύνους της AI, όπως παραβιάσεις και παραπληροφόρηση της ιδιωτικής ζωής. Οι γονείς θα πρέπει να μάθουν λίγο μόνοι τους εάν δεν είναι εξοικειωμένοι με το AI και τον ευρύτερο χώρο AI. 2023Ανασκόπηση τεχνολογίας MITΤο άρθρο προτείνει την έναρξη συνομιλιών νωρίς χρησιμοποιώντας ανοιχτές ερωτήσεις όπως "Χρησιμοποιήσατε νέα εργαλεία AI αυτήν την εβδομάδα;" Για να πάρετε τη συζήτηση.

- Ορίστε σαφή όρια: Δημιουργήστε ορισμένους βασικούς κανόνες σχετικά με τη χρήση εφαρμογών, τον χρόνο στο διαδίκτυο κλπ. Και προσπαθήστε να εξηγήσετε τη συλλογιστική σας για να οικοδομήσετε εμπιστοσύνη και να αποκτήσετε παιδιά στο πλευρό σας. Για παράδειγμα, περιορίστε το χρόνο συνομιλίας χρησιμοποιώνταςΏρα προβολήςστο iPhone ήΑποκλείστε τη χρήση του Διαδικτύουμέσω του δρομολογητή σας.

- Ενθαρρύνετε την κριτική σκέψη: Διδάξτε τα παιδιά να αμφισβητήσουν τις απαντήσεις του ΑΙ, επαληθεύοντας πληροφορίες από αξιόπιστες πηγές. Αυτή η προσέγγιση θα βοηθήσει στην άμβλυνση των κινδύνων παραπληροφόρησης.

- Ενθαρρύνει τις κοινωνικές αλληλεπιδράσεις σε πραγματικό κόσμο: Ενθαρρύνετε δραστηριότητες όπως οι αθλητικές ή οικογενειακές εκδρομές για την εξισορρόπηση της ψηφιακής δέσμευσης, μειώνοντας τη συναισθηματική εξάρτηση από το AI. Μελέτες έχουν δείξει ότι η έμφαση στις ανθρώπινες συνδέσεις μπορεί να αντιμετωπίσει την απομόνωση από τους συντρόφους του AI.

Οι θεραπευτές αρέσουνEmily Hemendinger, από το Πανεπιστήμιο του Κολοράντο Anschutz, υποστήριξαν αυτές τις στρατηγικές. Βοηθούν στην αντιμετώπιση του "Empathy Gap" του AI, όπου τα chatbots δεν κατανοούν τις συναισθηματικές ανάγκες ενός παιδιού.

Πρακτικές συμβουλές για τους γονείς: Τι μπορείτε να κάνετε

Για βήματα που μπορούν να ενεργοποιηθούν, οι γονείς μπορούν να υιοθετήσουν τα εξής:

- Μείνετε ενημερωμένοι: Ενημερώστε τις τάσεις του AI μέσω δωρεάν πόρων όπωςΘύλακα, που απαριθμούν τις κορυφαίες πλατφόρμες AI που χρησιμοποιούν τα παιδιά, συμπεριλαμβανομένου του χαρακτήρα.ai και του Snapchat's Myai.

- Οδηγεί με παράδειγμα: Μοντέλο υπεύθυνη τεχνική χρήση, όπως ο περιορισμός της προσωπικής οθόνης και η αποφυγή οθονών κατά τη διάρκεια εκδρομών ή οικογενειακών δείπνων.

- Αναζητήστε συμβουλές εμπειρογνωμόνων: Εάν προκύψει η ανάγκη, εξετάστε τη διαβούλευση εκπαιδευμένων επαγγελματιών, ειδικά όσον αφορά τα θέματα ψυχικής υγείας. Αυτό μπορεί να βοηθήσει στην προώθηση ανοιχτών συνομιλιών σχετικά με τις διαδικτυακές δραστηριότητες.

Συγκριτική ανάλυση: Τεχνικά έναντι επικοινωνιακών προσεγγίσεων

Για να σας δώσουμε μια ιδέα για την ισορροπία μεταξύ τεχνικών και επικοινωνιακών στρατηγικών, εξετάστε τον ακόλουθο πίνακα που συγκρίνει την αποτελεσματικότητα:

| Προσέγγιση | Σημάδια | Περιορισμοί |

|---|---|---|

| Γονικός έλεγχος | Μπλοκ πρόσβασης, περιορίζει την ώρα της οθόνης | Εύκολα παρακάμπτεται, δεν αντιμετωπίζει τις βασικές αιτίες |

| Ανοιχτή επικοινωνία | Δημιουργεί εμπιστοσύνη, εκπαιδεύει τους κινδύνους, ενισχύει το διάλογο | Απαιτεί συνεπή προσπάθεια, μπορεί να αντιμετωπίσει αντίσταση |

| Συνδυασμένη προσέγγιση | Ολοκληρωμένη, προσαρμοστική στους αναδυόμενους κινδύνους | Απαιτεί γονική ώρα και δέσμευση |

Η καλύτερη προσέγγιση είναι να συνδυαστούν οι τεχνικές και επικοινωνιακές στρατηγικές, αλλά αυτό απαιτεί μια μεγάλη εκ των προτέρων προσπάθεια και συνεχή χρόνο και πόρους για την παρακολούθηση, την ομιλία και την καθοδήγηση.

Συμπέρασμα και μελλοντικές εκτιμήσεις

Συμπερασματικά, η προστασία των παιδιών σας από τους κινδύνους της εφαρμογής χαρακτήρων AI χαρακτήρων απαιτεί κάτι περισσότερο από τεχνικές διασφαλίσεις, απαιτεί επίσης ενεργό γονική συμμετοχή μέσω ανοικτού διαλόγου και οικοδόμησης εμπιστοσύνης. Με την εκπαίδευση των παιδιών σας, τον καθορισμό των κατάλληλων ορίων και την προώθηση των αλληλεπιδράσεων σε πραγματικό κόσμο, μπορείτε να μειώσετε τους κινδύνους για την ιδιωτική ζωή, τους συναισθηματικούς και τους κινδύνους ασφαλείας που συζητήσαμε παραπάνω. Καθώς εξελίσσεται το AI, η διατήρηση των τελευταίων εργαλείων AI και η προσαρμογή της στρατηγικής σας θα είναι ζωτικής σημασίας για να εξασφαλίσετε ότι το παιδί σας μπορεί να πλοηγηθεί με ασφάλεια στο ψηφιακό τοπίο.

Συνιστώμενη ανάγνωση:Πώς να απενεργοποιήσετε την ειδοποίηση "εμπιστοσύνη σε αυτόν τον υπολογιστή" στο iPhone και το iPad